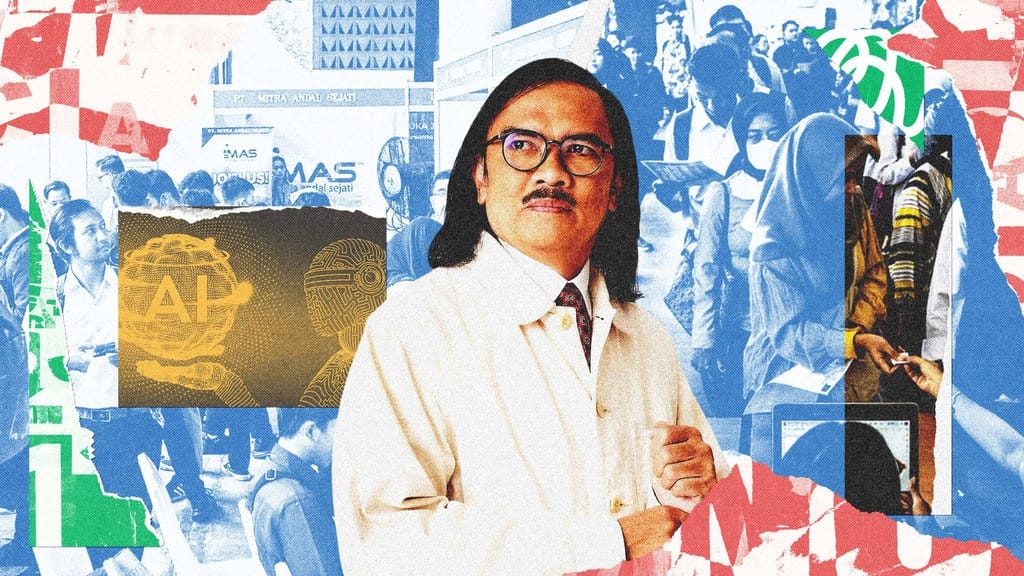

tirto.id - Ini bukan pandangan yang lagi-lagi pesismistis terhadap pengembangan dan pemanfaatan artificial intelligence (AI). Namun hari ini: eksistensi manusia ada di titik paling genting—akibat pengembangan AI—yang tak dapat diprediksi ujung terjauhnya.

Seluruhnya mempengaruhi eksistensi manusia di masa depan. Alih-alih manusia sebagai tenaga kerja, juga manusia beserta kemanusiaannya. Itu adalah tesis terpenting, “Genesis: Artificial Intlligence, Hope and The Human Spirit” buku karya Henry Kissinger, Eric Schmidt dan Craig Mundie, 2024.

Buku itu menjadi karya terakhir Henry Kissinger, legenda AS yang berkonstibusi besar menciptakan tatanan dunia, pasca-Perang Dunia II. Dia juga tersohor sebagai Menteri Luar Negeri AS ke-56, yang dikenal dunia saat meraih Nobel Perdamaian, tahun 1973. Karenanya, Kissinger yang wafat di usia ke-100 pada tahun 2023, bersama mantan CEO Google (Schmidt) , dan mantan Kepala Riset Microsoft (Mundie) itu, menerbitkan buku itu tanpa sempat disaksikan peluncurannya.

Tesis bernada pesimistis di atas, lantaran perangkat berbasis AI punya implikasi yang sama sekali berbeda dibanding mesin cetak maupun mesin uap. Di keduanya, memang pada awalnya juga muncul pertanyaan soal eksistensi manusia.

Mesin cetak yang ditemukan Johannes Gutenberg di tahun 1450, mampu mendorong terjadinya revolusi ilmu pengetahuan. Manusia saat itu, mampu mengartikulasikan pikiran abstraknya ke dalam artefak tercetak. Memudahkan distribusinya sebagai pengetahuan. Manusia sebagai mahluk berpikir, justru menemukan jalan kemuliaannya lewat mesin cetak.

Sedangkan di era mesin uap—temuan yang disempurnakan James Watt di tahun 1769—memberi tambahan pemberdayaan kemampuan fisik manusia. Produktivitas yang semula bergantung pada tenaga manusia, hewan, air dan angin, digantikan mesin bertenaga uap. Produktivitas yang dihasilkan berlipatganda. Pemanfaatannya, disusul penciptaan sistem ban berjalan yang memfasilitasi produksi barang massal. Tenaga fisik alamiah, digantikan oleh sistem pabrikasi. Di era ini pun, eksistensi manusia tak terabaikan.

Baru pada lompataan temuan mendunia berikutnya, sistem berbasis AI, persoalan eksistensi manusia mengemuka. Di antara laju perkembangannya—bahkan dengan kecepatan yang tak tercerna nalar alamiah—telah mengubah praktik kerja, perilaku sosial politik, maupun struktur budaya, yang nyata mendesak eksistensi manusia.

OpenAI misalnya, yang meluncurkan ChatGPT versi kelimanya, Kamis 7 Agustus 2025—menurut CEO-nya, Sam Altman, versi ini menjanjikan kecerdasan yang setara dengan seorang PhD. Ketika sebelumnya banyak perusahaan menyewa konsultan manajemen atau mengandalkan rekomendasi dari orang berkapabilitas tinggi—karenanya was-was dengan tagihan yang mahal—dengan GPT-5, layanan berkecerdasan tingkat doktoral tersedia.

Biaya penggunaan agregatnya lebih murah, aksesnya tersedia realtime. Dan ketika mampu memenuhi kebutuhan secara efisien, mengapa masih harus mengandalkan konsultan manusia?

Pernyataan di atas, senada dengan pendapat Geoffrey Hinton—tokoh yang dikenal sebagai ‘bapak AI’ akibat temuannya di bidang jaringan saraf tiruan. Dia sempat bergabung dengan Google, di divisi Google Brain, pada 2013 hingga 2023— yang dikutip oleh timesofindia.

Hinton menyebut: perlu diadakannya perdebatan baru di antara para pemikir AI dalam penyusunan proposal yang menyangkut keamanan AI. Pernyataan yang disampaikan pada konferensi Ai4 di Las Vegas itu, sambil diusulkannya penanaman naluri keibuan agar memastikan AI mau melindungi dan merawat manusia.

Hinton yang bersama John Hopfield menerima Nobel di bidang Fisika pada tahun 2024 ini, sebelumnya telah memperingatkan adanya kemungkinan 10-20 persen, AI, yang pada akhirnya dapat menyebabkan kepunahan manusia. Pernyataan itu menyusul kekhawatiran yang berkembang, selama bertahun-tahun tentang laju perkembangan AI dan potensi risikonya.

Tesis dalam “Genesis” di atas, jika diurai sebagai rician pernyataan—ini dirumuskan di antaranya oleh Hans van 't Riet, 2025, sesaat setelah menyimak buku di atas— poinnya:

pertama, apa yang terjadi jika AI membuat keputusan yang tidak dapat dijelaskan sepenuhnya oleh pembuatnya?

Kedua, bagaimana manusia melestarikan nilai-nilai kemanusiaan dalam sistem yang belajar dari data, dan bukan etika?

Dan ketiga, dapatkah AI menjunjung tinggi martabat manusia—atau hanya akan dioptimalkan untuk kegunaan saja?

Terhadap pertanyaan pertama, fenomena ini sering disebut sebagai AI black box. Sebuah keadaan: tak seluruh kerja AI dapat dipahami. Bahkan oleh ahli yang merancangnya. Ketika AI yang tak selalu dapat dipahami, namun diandalkan memproduksi keputusan yang menentukan nasib manusia adalah keadaan paradoks.

Yuval Noah Harari, 2024, dalam bukunya “Nexus: A Brief History of Information Networks from the Stone Age to AI” mengilustrasikan: saat manusia membuat keputusan, justru aspek yang cenderung tunggal dan beralasan yang digunakan untuk menyusun keputusan. Sehingga manusia lain, memahami keputusan itu. Sedangkan saat AI menyusun keputusan, justru faktornya sangat kompleks tak akan dipahami nalar alamiah manusia.

Misalnya, saat seorang bankir hendak memutuskan pemberian kredit yang dipertimbangkan adalah penghasilan orang itu. Jikapun ada pertimbangan lain, setidaknya jumlah pengeluaran rata-rata bulanannya, berikut kemungkinan penghasilan tambahan lain. Dari variabel itu dapat ditentukan: pemberian dan penolakan kredit dengan indikator jelas.

Sedangkan ketika AI yang membuat keputusan, selain tiga variabel di atas juga data kompleks lain turut dipertimbangkan. Ini termasuk brand perangkat selular yang digunakan, saat seseorang mengajukan kredit. AI tahu brand selular yang digunakan, dan diperiksa peluangnya menggunakan algoritma yang disusun machine learning. Orang pengguna brand sejenis itu, berapa persentasenya akan mengalami gagal bayar.

Demikian juga saat mengisi aplikasi pengajuan kredit, berapa persentase daya baterai yang tersisa dan belum diisi kembali. Ini dikaitkan dengan algoritma persentase daya baterai yang sama dengan orang lain, dan peluangnya sukses melunasi kredit.

Sehingga, betapa pun transparannya sistem penilaian yang digunakan AI untuk menetapkan keputusan, juga aspeknya yang dapat dipahami manusia, masih banyak hal lain yang kompleks dan tak dimengerti. Lalu bagaimana jika dalam kekompleksan itu terdapat hal yang mendiskriminasi kemanusiaaan?

Persoalan berikutnya, mampukah AI melestarikan sistem manusia yang etis? Machine learning mengumpulkan data tentang aspek etika dan dapat menyusun algoritmanya tentang praktik etis. Berdasarkan data yang diinput, AI tampak beretika. Namun sama sekali bukan pertimbangan etika pada dirinya sendiri.

Etisnya kerja AI, lantaran operasi statistik pada data di dalam sistem komputasional yang sudah etis. Kerja AI tergantung pada data yang ada di dalam sistem belajarnya, dan produk dihasilkan sesuai datanya. Ketika datanya tak bernilai etis, maka keputusan yang dihasilkannya juga tidak etis.

Mengandalkan kerja AI yang tak memiliki aspek etis, kecuali tergantung datanya, dapat menggusur nilai etis kemanusiaan. Contohnya saat mobil tanpa awak yang hendak dimiliki, calon pemiliknya harus menandatatangani pernyataan. Dalam keadaan hanya satu pilihan—mobil harus memilih orang yang harus diselamatkan—siapa yang akan diselamatkannya: orang yang ada di dalam mobil. Atau orang yang ada di luar mobil? Jelas keputusan AI bukan karena pertimbangan etis sistemnya, namun data saat pengembangan mobil sebelum diluncurkan ke jalan raya.

Dan terakhir, dasar pengembangan AI adalah hukum-hukum ekonomi. Besarnya keuntungan yang dapat diraih, efisiensi yang dapat dicapai. Juga penggunaan waktu yang dipersingkat. Seluruhnya terkait dengan peluang pertumbuhan baru. Pertimbangannya pragmatis.

Ketika AI diandalkan untuk tercapainya presisi dignosis penyakit, memang terbukti ketepatannya makin menyamai atau lebih tinggi dari diagnosis dokter manusia. Aktivitas penentuan penyakit menjadi efisien, hemat waktu dan berimplikasi pada turunnya biaya pemeriksaan. Ini setidaknya ketika dibandingkan dengan pemeriksaan konvensional, yang harus menggunakan berbagai laboratorium maupun aneka perangkat. Biayanya jadi mahal, dengan hasil yang tak mutlak.

Demikian pula ketika AI digunakan untuk menilai kemungkinan kambuhnya perbuatan jahat narapidana. Prosesnya yang memanfaatkan AI lebih cepat, berpresisi tinggi. Ini lantaran big data pendukungnya, sangat andal. Upaya penegakan hukumnya lebih murah. Tentu tindakan kejahatan kambuhannya juga dapat ditekan.

Namun saat dikaitkan dengan aspek pertama, bagaimana martabat manusia–yang sakit maupun yang berpeluang mengulang kejahatannya–diserahkan pada perangkat yang dirancang untuk kegunaan pragmatis yang dioperasikan secara mekanis?

Maka menjadi makin perlu direfleksikan pertanyaan-pertanyaan yang dikembangkan berdasar tesis ketiga penulis di atas: di hadapan AI, eksistensi manusia berikut nasib kemanusiaannya, berada dalam posisi genting. Jika memang demikian, lalu apa tujuan akhir pengembangan AI, jika nasib pengembangnya justru terancam?

Editor: Alfons Yoshio Hartanto

Masuk tirto.id

Masuk tirto.id