tirto.id - Suatu hari pada 2019 silam, Shinola kemalingan. Lima jam tangan mewah yang diperkirakan bernilai $3800 hilang digondol penjahat dari toko jam tangan di Detroit, Michigan, Amerika Serikat itu. Polisi melakukan penyelidikan untuk mengungkap kasus. Bobby Allyn, dalam laporannya untuk NPR, menyebut polisi mengamankan rekaman CCTV di sekitar lokasi kejadian. Sialnya, hasil rekaman CCTV tersebut hanya menampilkan gambar buram terduga pelaku kejahatan. Bukannya menyerah, polisi memproses gambar buram terduga kejahatan menggunakan aplikasi artificial intelligence. Dan tak lama kemudian, muncul nama Robert Julian-Borchak William sebagai terduga--versi artificial intelligence.

Dengan bekal informasi itu polisi menangkap William di kediamannya pada Januari 2020. Ketika disodori tangkapan layar CCTV, William mengklaim bahwa "saya hanya melihat sosok buram saja. Saya hanya melihat pria kulit hitam. Dan setelah dilihat-lihat dengan seksama, saya pikir sosok tersebut bukan saya."

Waktu berlalu dan klaim William terbukti benar. Bukan dia penjahatnya. Mesin artificial intelligence yang digunakan polisi untuk rupanya menghasilkan informasi palsu karena bias warna--karena artificial intelligence lebih sering diajari mengidentifikasi wajah melalui foto-foto orang-orang kulit putih. ACLU cabang Michigan, organisasi advokasi HAM setempat, mengajukan gugatan hukum terhadap Kepolisian Detroit atas kelalaian ini.

Kelalaian mesin tak hanya menimpa William. Pada pertengahan Februari 2020 lalu, misalnya, Eyal Weizman, arsitek sekaligus aktivis asal London, gagal mendapat visa kunjungan ke AS saat hendak mengunjungi pameran yang diadakan Forensic Architecture, lembaga non-profit yang rajin membongkar borok pemerintah dan perusahaan melakukan tindak kekerasan.

Paman Sam menolak permohonan Weizman atas dasar algoritma milik AS yang mengindentifikasi si pemohon sebagai sosok "berbahaya". Petugas kedutaan AS di London, dengan mengutip informasi dari mesin milik AS, "menyatakan bahwa Weizman telah terlibat dalam suatu kejahatan atau telah bertemu dengan orang-orang yang dianggap penjahat oleh AS". Usai merenung, Weizman menduga bahwa salah informasi algoritma pada dirinya terjadi karena ia sempat mengunjungi Suriah, Iran, Irak, Yaman, dan Somalia--negara-negara yang dimusuhi atau diporakporandakan AS.

Menurut penuturan Weizman, ia akan diberikan jalur khusus pengurusan visa untuk masuk ke AS asalkan bersedia mengatakan dengan siapa saja ia bertemu dalam beberapa bulan terakhir. Namun, sebagai seseorang yang bekerja sebagai aktivis Hak Asasi Manusia, Weizman menolak. Dengan tegas Weizman mengatakan bahwa “kita, sebagai warga negara, telah dipantau secara elektronik. Dipantau atas jaringan sosial, orang-orang yang kita temui, tempat, sambungan telepon, hingga transaksi yang kita lakukan”.

“Sistem pemantau seperti yang telah saya alami, menimbulkan banyak masalah,” katanyanya.

Kisah seperti William dan Weizman nampaknya terulang. Polisi kembali menggunakan teknologi kontroversial ini dalam investigasi peryerbuan Gedung Capitol.

Dari Parler menuju Clearview AI

Untuk mengungkap aktor-aktor kerusuhan di Gedung Capitol, Washington DC, Januari lalu, aparat keamanan AS memanfaatkan rekaman kamera dan media sosial, khususnya Parler, aplikasi media sosial untuk kaum konservatif garis keras. Kate Cox, dalam laporannya untuk Ars Technica, menyebut polisi setempat dan FBI telah mengamankan ribuan foto terduga perusuh, rekaman CCTV, hingga rekaman yang diunggah ke media sosial oleh si terduga sendiri (betapa konyolnya pendukung Donal Trump). Untuk mengidentifikasi lebih jauh, tentang siapa sosok di balik foto yang berhasil diamankan, aparat menggunakan bermacam teknologi, termasuk facial recognition.

Teknologi facial recognition beroperasi dengan dua pendekatan. Pertama dan yang paling usang, mesin pengenal wajah menentukan siapa sosok dalam sebuah melalui kriteria yang bersumber dari basis data, misalnya kumpulan mugshot (jepretan foto pelaku kejahatan di kantor polisi). Kumpulan mugshot dianalisis kriteria umumnya, seperti jarak antar mata, besar hidung, dan pertanda wajah lainnya. Ketika kamera merekam seseorang, komputer mencocokkan gambar wajah yang ditangkap kamera dengan basis data yang ada. Jika cocok, mesin akan mengeluarkan nama. Jika tidak, mesin tidak akan mengeluarkan hasil sampai terdapat basis data baru yang sesuai dengan kriteria gambar yang terekam kamera.

Pada pendekatan kedua, facial recognition memakai machine learning atau artificial intelligence yang tak hanya memiliki basis data mugshot, melainkan juga basis data jutaan (atau bahkan miliaran) foto/rekaman yang tersebar di manapun, entah CCTV atau media sosial. Dengan menengok Instagram, misalnya, machine learning dapat memperoleh 95 juta foto setiap hari (jumlah foto yang diunggah pengguna Instagram setiap hari). Bukan cuma wajah atau tanda-tanda fisik, kecerdasan buatan juga mengidentifikasi seseorang dengan tanda-tanda lain, misalnya topi, kacamata, atau baju.

“Ada banyak pertanda yang dapat kami gunakan (untuk mengidentifikasi seseorang). Orang dengan aspek karakteristik tertentu, bahkan jika kamu melihatnya dari belakang [...] Sebagai contoh, kamu bisa mengenali Mark Zuckerberg dengan mudah karena dia selalu mengenakan kaos berwarna abu-abu,” ungkap Yann Lecun, kepala divisi kecerdasan buatan Facebook, sebagaimana dikutip dari Wired.

Untuk mengungkap pelaku perusuh di Gedung Capitol, FBI dkk. memiliki dua alat canggih. Alat pertama: bantuan masyarakat.

Para perusuh di Gedung Capitol mengunggah aksi mereka di media sosial, Parler khususnya. Sialnya, dalam laporan Andy Greenberg untuk Wired, Parler memiliki cacat desain, yang uniknya, sangat elementer. Siapapun yang baru belajar pemrograman web rentan mengalami masalah ini. Parler menampilkan data dari basis data mereka secara kronologis dan tidak membuat sistem otentikasi untuk mengaksesnya.

Jika Anda pernah belajar pemrograman web, Anda pasti paham dengan link dalam bentuk seperti ini: https://tirto.id/artikel.php?id=3, di mana "3" merujuk pada data di baris ke-3 dalam basis data secara kronologis. Artinya, ada data dari 1 hingga sekian dalam suatu basis data yang dapat diakses dengan mudah. Umumnya, celah seperti ini dapat diatasi dengan mengubah pengaturan pada "htaccess", mengubah https://tirto.id/artikel.php?id=3, misalnya, menjadi https://tirto.id/hape-terbaru-murah. Atau, jika dirasa sangat penting, dapat dilindungi melalui sistem otentikasi dan hanya memberi izin akses basis data melalui API. Parler tidak demikian. Seminggu sebelum website ini offline karena Amazon Web Service--tempat hosting Parler--mendepaknya, peretas sukses menggondol puluhan terabita basis data mereka berbekal kode scrapping website.

Sebagian data Parler, ditambah rekaman yang tersebar di berbagai media sosial, akhirnya jatuh ke seorang pemuda yang tinggal di sekitar Washington DC. Ia menciptakan situsweb "Faces of the Riot", yang menampilkan para perusuh Capitol. Dengan bantuan machine learning, situs ini pun melakukan identifikasi atas sosok-sosok yang terekam.

"Jika Anda mengunjungi website ini dan melihat seseorang yang dikenal, mungkin orang akan berpikir, 'Oh, saya kenal dia dan saya akan laporkan ke pihak kepolisian," kata pencipta "Faces of the Riot", sebagaimana diungkapkannya secara anonim kepada Wired.

"Faces of the Riot" hingga hari ini menyimpan lebih dari 6.000 foto yang siap ditengok aparat penegak hukum.

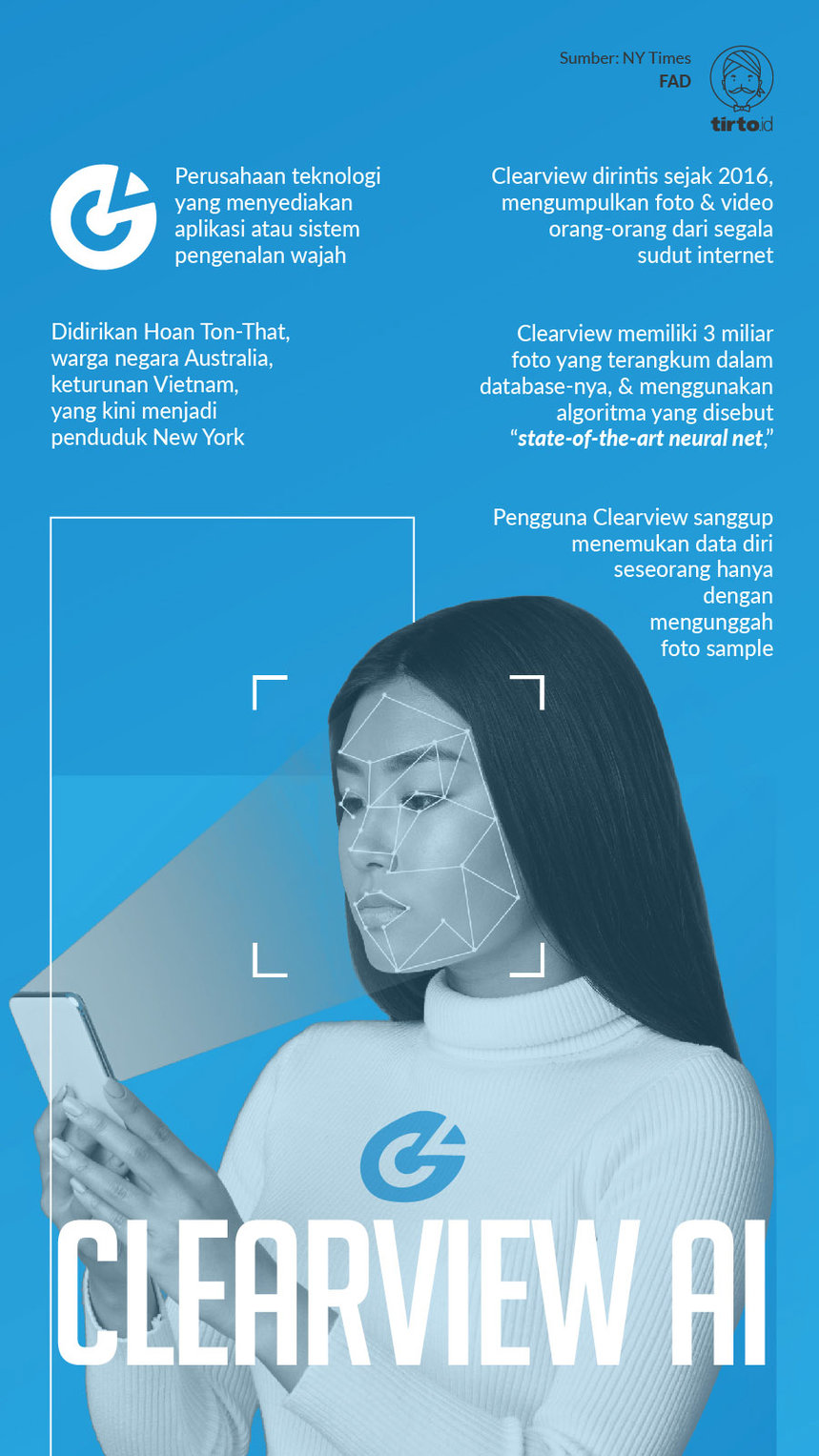

Alat canggih kedua: Clearview AI, aplikasi facial recognition buatan Hoan Ton-That, warga negara Australia keturunan Vietnam yang kini menjadi penduduk New York.

Kashmir Hill, dalam laporannya untuk The New York Times pada awal 2020 silam, mencurigai AS telah lama menggunakan alat bernama Clearview AI untuk melakukan investigasi serta pengawasan terhadap warganya. Dalam dokumen yang diperolehnya, Clearview AI disebut-sebut dapat menganalisis tiga miliar foto atau video orang di seluruh dunia. Klaim Clearview di dokumen tersebut: angka itu jauh lebih perkasa dibandingkan database yang dimiliki otoritas penegak hukum apapun di AS, termasuk FBI (yang disebut-sebut hanya memiliki 411 juta database foto), kepolisian Florida (47 juta foto), dan kepolisian Los Angeles (8 juta foto).

Diciptakan pada 2016, Clearview mengumpulkan foto dan video manusia dari segala sudut internet, mulai dari situsweb kantor, sekolah, blog pribadi, hingga platform media sosial seperti Facebook, Youtube, Twitter, dan Instagram. Dengan menambang data dari berbagai sumber internet, tak aneh jika Clearview memiliki tiga miliar foto dalam basis datanya. Bagi Ton-That sendiri, Clearview merupakan “state-of-the-art neural net” untuk mendeteksi seseorang, yang tercipta karena “Clearview membuat direktori besar dan mengelompokkan semua foto dengan vektor yang sama".

"Ketika seorang pengguna mengunggah foto ke dalam sistem Clearview, sistem mengubah wajah menjadi vektor dan kemudian menunjukkan semua foto yang memiliki kemiripan vektor, lengkap dengan link asal foto," tambah Ton-That.

Kecurigaan Hill terbukti dalam tempo yang relatif cepat. Pada Agustus lalu, aparat penegak hukum di New York dan Miami terbukti memanfaatkan Clearview AI untuk menangkap pemrotes Black Live Matter yang dianggap bikin onar.

Tindakan menangkap demonstran--yang menggugat kebrutalan polisi terhadap warga kulit hitam di AS--dengan bantuan Clearview itu berbanding terbalik dengan apa yang diungkap Komisaris Kepolisian Kota New York James O'Neill dalam tulisan kololmnya di The New York Times. Facial Recognition, yang diakuinya telah digunakan sejak 2011, "tidak mengambil foto dari Departemen Kendaraan Bermotor, Facebook, kamera lalu lintas, atau CCTV di seluruh kota."

Pemanfaatan artificial intelligence, machine learning, facial recognition dengan tujuan dan alasan apapun sangat kontroversial, terutama karena teknologi ini belum sempurna. Studi bertajuk “Semantics Derived Automatically from Language Corpora Contain Human-like Biases” (2017) yang ditulis Aylin Caliskan memaparkan ketika kecerdasan buatan menggunakan data dari internet, seperti yang dilakukan Clearview dan "Faces of the Riot", sistem yang tercipta akan menghasilkan stigma terhadap orang-orang berkulit hitam, perempuan, dan Asia. “Banyak orang berpikir bahwa mesin tidak mungkin bias,” tulis Aylin Caliskan, “yang perlu diingat, mesin dilatih oleh data yang diberikan manusia. Dan manusia adalah makhluk yang bias.”

Editor: Windu Jusuf