tirto.id - Total terdapat 112 kasus dugaan pelanggaran perlindungan data pribadi yang dicatat Kementerian Komunikasi dan Informatika (Kominfo) dalam kurun 2019 hingga 2023. Sebanyak 3 kasus terjadi di 2019, kemudian kasus meningkat signifikan di tahun berikutanya yakni, 21 kasus di 2020, 20 kasus di 2021, 35 kasus di 2022, dan 33 kasus di 2023.

Dari 112 kasus, 99 di antaranya merupakan kasus kebocoran data pribadi, 3 kasus pengumuman data pribadi, 3 kasus pengungkapan data pribadi kepada pihak yang tidak sah, 2 kasus pengumpulan data pribadi yang berlebihan serta lima kasus lainnya.

Dalam data tersebut, diketahui pula sebanyak 76 kasus merupakan penyelenggara sistem elektronik (PSE) swasta, sisanya atau 36 kasus merupakan PSE publik.

Dengan masifnya kasus pelanggaran data pribadi tersebut, tentunya berbanding lurus dengan kebutuhan cyber defender yang juga meningkat.

Teknologi generatif AI disebut-sebut mampu menjawab masalah-masalah tersebut. Namun siapkah Indonesia? Dan sudah sejauh mana pemerintah Indonesia menerapkan teknologi anyar ini dalam sistem pelayanan mereka?

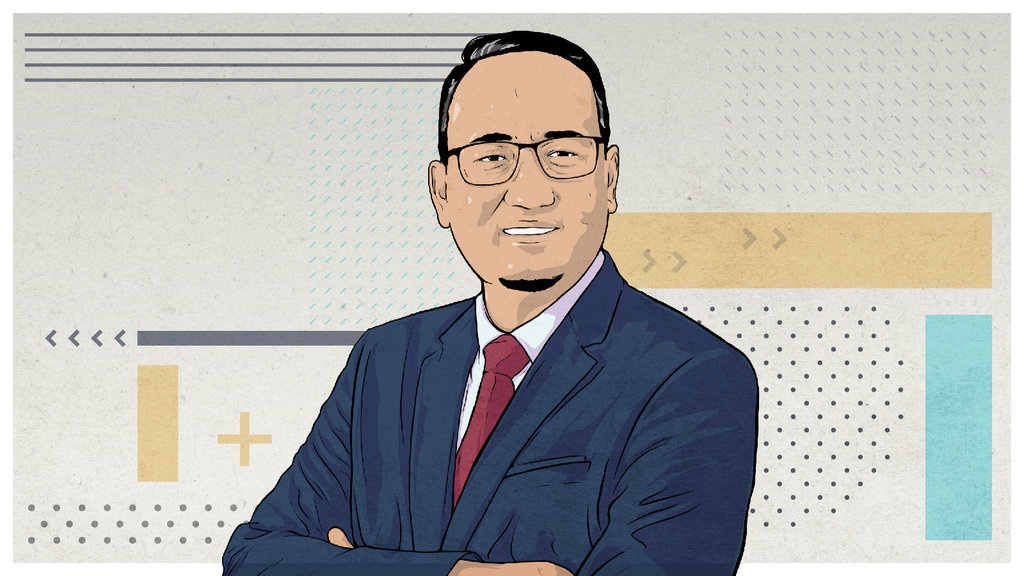

Dirjen Aplikasi Informatika (Aptika) Kominfo Semuel Abrijani Pangerapan membahasnya dalam wawancara bersama Tirto, Kamis (26/10/2023).

Apa tantangan yang Kominfo lihat untuk menjaga keamanan siber di Indonesia?

Bukan tugas kami yang menjaga, tugas kami yang menjaga keamanan siber ini ada semua orang yang memiliki sistem yang beroperasi di ruang siber.

Jadi memang tantangannya kalau kita sedang mau masuk ke ruang digital, yang harus di awalnya adalah memitigasi risiko. Karena kita harus tahu ruang digital itu adalah ruang yang terbuka, jadi ruang kaca. Dan karena dia terbuka dan untuk memudahkan berinteraksi dan berinterkoneksi dengan sistem-sistem yang lain, mereka harus memitigasi yang mana yang tidak boleh terbuka. Dan itu menurut undang-undang itu adalah tugas mereka [penyedia sistem elektronik].

Nah, kami mengawasinya apabila ada kebocoran atau apabila ada insiden cyber security, ada kebocoran data, data pribadi masyarakat. Nah itulah kita masuk untuk melakukan investigasi. Memastikan hak-hak masyarakat terlindungi. Jadi bukan tanggung jawab kita. Kebocoran data dan keamanan siber itu adalah tanggung jawab penyelenggara.

Dari kasus-kasus yang terjadi, Anda melihatnya, mengapa itu bisa terjadi?

Yang namanya ruang digital itu terbuka. Terjadinya karena mereka lupa menutup. Kalau kita bicara keamanan siber itu ada 4 layer.

Pertama adalah jaringannya. Jaringan yang mereka gunakan sudah harus secure. Jadi gak mungkin ada orang di tengah jalan melakukan kegiatan ilegal di jaringannya. Jadi dia memastikan bahwa end-to-endnya itu adalah secure. Itu baru jaringannya.

Kedua, mereka punya sistem terdiri dari komputer segala macam. Komputer pun didisain, sistem-sistem ini didesain yang sudah resilient, yang tahan terhadap serangan. Jadi makanya sistem juga harus dipastikan.

Yang ketiga, aplikasinya. Aplikasi bisa di-hack gitu, di-penetrate atau disusupi orang. Misalnya, banyak pinjol-pinjol masuk ke website pemerintah. Jadi keamanan aplikasinya juga.

Nah yang terakhir, datanya. Datanya kan banyak. Datanya yang mana yang harus dienkripsi? Apabila terjadi kebocoran, tidak terlalu banyak yang dirugikan khususnya masyarakat. Terutama data-data pribadinya. Karena kalau dienkripsi semua, kan jadi enggak nyaman dan prosesnya akan lama. Nah mereka harus memitigasi. Memitigasi dari data-data ini yang enggak boleh sampai terbocor, jadi tidak ada nilainya. Seperti data-data pribadi dan data-data keuangan.

Dan katakan, karena kan tadi ruang digital itu terbuka. Jadi kebocoran ataupun serangan itu, bukan lagi ngomong bagaimana, tapi kapan. Karena sudah harus antisipasi. Kan tadi, walaupun 4 layer, kan harus antisipasi. Nah itu memitigasi risikonya, risiko yang paling besar adalah apabila datanya bocor.

Masa untuk preventifnya, pemerintah tidak bisa melakukan apapun, misalnya dengan regulasinya?

Ada. Kalau nanti data pribadi itu [bocor], kena denda dia [PSE]. Kalau dia terjadi kebocoran, bukannya dibantu sudah kemalingan, dia didenda lagi. Itu untuk apa? Untuk mereka meningkatkan keamanan sibernya. Lo mau invest untuk meningkatkan keamanannya atau lo nanti gue denda. Karena kebocoran data atau insiden siber di era digital sekarang itu bukan hanya karena dia nanti karena akan didenda oleh pemerintah. Kamu mau enggak menggunakan layanan dari sebuah perusahaan yang keamanan sibernya lemah? Begitu ada berita aja, semua orang tanya aja duitnya. Wah duit gue ilang. Kalau dia itu bermain di era, di sektor finansial. Atau yang lainnya. Kan layanan banyak, bukan hanya dia satu-satunya.

Jadi selain tadi mereka akan kena denda, mereka akan kehilangan reputasi. Makanya mereka harus, di undang-undang ITE sangat jelas, bertanggungjawab terhadap keamanan siber. Mereka harus membangun keamanan siber yang andal.

Sekarang soal AI, yang ramai jadi perbincangan, selain membantu kerja-kerja remeh, misalnya jawab email, smart reply, tapi juga beberapa platform bilang bahwa ini bisa membantu mengatasi keamanan siber atau mencegah. Anda sepakat?

Ya bisa. Karena dia itu kan kayak manusia juga. Daripada kita mau hire banyak, kita harus lihatin terus jaringannya. Ini kan secara sistem, dia akan patroli. Patroli lihat jaringannya, ada yang bocor enggak di jaringan. Sistemnya ada. Lihat di aplikasinya. Dan mereka bisa memantau. Dia kan di digital. Ini ada dibangun semacam sebuah program, algoritma, yang dia bisa memantau. Irregular transport data, kok saya enggak perhatiin data ini, kenapa ada keluar? Nah itu dia bisa mencegah. Karena lebih cepat lah, kerjanya mereka. Dan itu memungkinkan dilakukan oleh AI.

Nah implementasinya di Indonesia terutama di sektor e-government itu sudah sampai mana?

Belum ini. Yang sekarang aja belum optimal.

E-governmentnya?

Iya. Maksudnya kan begini. Kamu mau itu kan mau sprint. Kita belum bisa. Kan itu harus ada tahapannya. Kan harus ada kesiapan SDM-nya juga.Pasti menguasai teknologi SDM-nya. Dan membangun teknologinya.

Teknologi sendiri kan juga bukan hal yang murah. Ada estimasi berapa?

Enggak tahu saya. Dan sekali lagi, kami tidak menangani segala keamanan siber.

Artinya, kalau boleh saya simpulkan, berarti kita belum siap untuk membawa teknologi AI ini to the next level?

AI itu memang ada negara yang sudah siap? Enggak ada juga. Semuanya lagi membangun. Ada yang berani enggak pakai AI untuk keamanan sibernya? Belum ada. Mereka semuanya di test lab lah. Bahwa itu gak mungkin diberani. Pasti masih tetap ada orang, manusianya. Wah, berani ya. Karena masih pengembangan. Bisa digunakan? Ya bisa. Mungkin saja nanti AI bisa menggantikan operasi bedah lebih persisi. Kalau sudah ini, tapi AI menjanjikan yes, AI itu menjanjikan dan bisa membantu kerja manusia akan lebih presisi. Tapi kan kalau kita sekarang ini, AI yang sudah digunakan itu untuk hal-hal yang sifatnya repetisi.

Nah tadi AI juga bisa untuk melindungi, perlindungan data pribadi. Tapi masalahnya AI ini juga bukan yang sempurna banget. Ada hal-hal yang mungkin dia bisa jadi false alarm.

AI itu buatan manusia. Jadi apa yang kita kerjakan kita tuangkan dalam sebuah algoritma akhirnya mesin yang melakukan. Ya namanya buatan manusia juga pasti ada biasnya. Makanya tergantung AI-nya apa. Siapa yang membangun. Tujuannya apa. Makanya tiap kali AI dibangun tuh selalu dievaluasi. Feedbacknya bener gak? Kan kita kayak-kayak manusia juga. Kalau belajarnya salah kan, ilmunya jadi salah. Inputnya, datanya salah keluarnya garbage. Nah itu ada rumus yang harus diikuti, di ruang digitalnya kayak gitu.

Kalau di e-government sendiri, yang diampu sama Kominfo, penggunaan AI itu sudah sampai di mana?

Kalau di Kominfo namanya mereview konten-konten pornografi. Itu bukan manusia. Kamu lihat semua orang, manusia, anak buah saya, tiap 6 bulan itu harus pergi ke psikolog. Kebayang enggak, anak-anak itu melihat tiap hari, ngeliat pornografi. Kan bisa berpengaruh kalau dia tidak tahu. Ini kerjaan lho. Jadi dia harus membuat benteng. Jangan-jangan jadi ketagihan. Atau dia mengevaluasi konten-konten radikal. Jangan-jangan nanti dia yang terjadi radikal.

Yang kedua yang kita lakukan adalah proses pengidentifikasian konten-konten perjudian. Tiap hari 10 ribu [konten]. Dan itu kan kita harus, website judi yang kita mau tutup, kita harus mempunyai bukti. Berarti harus dibuka satu-satu. Kebayang gak 10 ribu konten, orang itu harus meluangkan waktu. Makanya AI membantu kami. Jadi dia buka, cek-cek, dia lihat oh iya bener ini judi, langsung langsung melayani sistem. Prosesnya akan lebih cepat. Jadi itu mereka sudah pakai, tapi belum sampai untuk keamanan.

Sekarang kalau untuk pornografi itu kami sudah 95 atau 93 ya, 93 persen dilakukan AI. 7 persennya manusia. Kenapa masih menggunakan manusia? Karena kan kadang-kadang dia pakai bahasa. Kan kita tadinya hanya gambar. Gambarnya kadang di halaman depan bukan pornografi. Terus diklik lagi baru masuk keluarnya. Kan mereka yang penjahat-penjahat ini kan lebih canggih juga. Jadi memang pasti ada celahnya. Kan belum sempurna. Jadi karena kan kita modelnya bukannya memfilter berdasarkan kata kunci. Tapi benar-benar kita temukan di situ bahwa yang mengandung konten perjudian atau pornografi. Baru kita lakukan pemblokiran.

AI ini bagian dari teknologi yang sifatnya seperti pisau bermata dua. Bisa buat defense. Bisa buat hal-hal baik. Tapi juga bisa buat hal-hal buruk. Nah, apa yang kira-kira yang bisa diantisipasi?

Setiap teknologi kan pasti ada plus minusnya. Karena ilmu kan sama. Pokoknya itu harus didasarkan. Makanya yang niatannya jahat itu kita atur dalam undang-undang, itu adalah tindakan pidana. Tugasnya si penyelenggara mengamankan dari segala kemungkinan. Itu harus menjadi tanggung jawab. Makanya tadi, kalau bisa, kalau jaringannya jebol, oke gak apa-apa. Layanannya jadi terganggu. Sistemnya jebol, oke. Layanannya terganggu. Kalau aplikasinya enggak jalan. Tapi datanya? Makanya ini yang paling besar [dampaknya], pihak ketiga atau rakyat yang datanya ada di situ tidak dirugikan. Karena lain-lainnya bisa diperbaiki.

Tapi bagaimana agar kita ini manusia, masyarakat ini bisa beradaptasi untuk tidak bisa tergantikan oleh AI? Haruskah punya skill tertentu?

Hati. Nalarnya itu sudah dibentuk oleh pembuatnya. Kalau hati kenapa ya? Manusia itu kan berpikirnya bukan hanya dengan pikirannya, tapi dengan hatinya. Secara logisnya oke logis, tapi boleh enggak kamu lakukan? Nah itu kan yang belum ada. Kesadaran.

Kalau bagi saya ke depannya pembangunan teknologi apapun harus berdasarkan human-centris. Centernya adalah manusia. Ini akan membantu manusia bukan menggantikan manusia. Pada poin-poin tertentu apakah, contohnya, apakah suatu kerjaan yang cuma menerima kartu-kartu di sini itu bukan pekerjaan. Itu hukuman kalau menurut saya. Apalagi dikerjakan oleh orang yang sebenarnya punya kemampuan lebih. Itu hukuman. Tidak akan produktif dia di sana. Dia akan lebih produktif. Dan manusia akan melakukan hal yang efektif.

Kalau Dirjen Aptika sendiri melihat perkembangan AI ke depannya, apa yang terdekat yang bisa dilakukan?

Terdekat kan kami ada kemarin dari BRIN, dulunya BPPT, mengeluarkan strategi nasional tentang AI. Stranas AI. Dan kami terlibat di dalamnya. Even dengan mereka kita bekerjasama, kan kami juga punya data-data yang banyak. Itu kami keluarkan data pribadinya untuk dimanfaatkan, untuk feeding AI supaya lebih cerdas. Siapapun yang ingin mengembangkan AI di Indonesia, masih harus ada kerjasama ya. NDA ya. Non Disclosure Agreement-nya. Untuk penelitian kami membantu banyak juga.

Jadi data-data yang sudah kami bersihkan dari data pribadinya, kami persilakan gunakan. Untuk meningkatkan kemampuan AI mereka. AI kan sebenarnya otak manusia dibangunnya terus dikasih informasi agar bisa mengolah.

Contohnya untuk proyek apa?

Belum tahu. Tapi setahu saya, mereka lagi menggunakan Natural Language, NLP. Natural Language Programming. Jadi supaya program itu bisa mengenali bahasa-bahasa manusia seperti kita yang ngomong ini. Akhirnya dia, oh ya ini percakapan manusia itu bagaimana sih? Ini kan kadang-kadang kata kan artinya tidak dalam kata itu sendiri. Intonasi mengaruhi, buat gestur. Bagaimana mengajari gestur, kan AI tidak lihat, kecuali AI-nya dikasih kamera waktu dia ngomong, untuk menganalisa. Kan arti kata yang kita keluarkan, kalau kamu hanya dengarkan saya di podcast suara, tanpa kamu lihat gerakan tangan saya, itu kan pemahamannya berbeda. Nah itu itulah, itu dikasih apa ya yang bisa memintarkan AI ini. Itu digunakan. Kalau kalimat ini, artinya itu ini. Jadi diajarin terus sampai dia begitu ada orang ngomong, interaktifnya kamu seperti ngomong sama sesama manusia.

Jadi ke depannya ya, kalau kita lihat ya. Banyak sekali manfaatnya. Dan saya tidak, posisi saya terhadap teknologi itu selalu netral dan selalu mendukung. Karena memang amanah dari undang-undang ITE. Negara ini wajib mendorong pengembangan teknologi.

Pemerintahan itu untuk yang teknologi AI ini sendiri, mereka bangun sistem sendiri atau ada kerjasama dengan pihak ketiga?

Sekarang banyak, yang simple-simple kita bangun sendiri. Tapi kalau sudah yang kompleks ya kita kerjasama. Ngapain kita bangun? Biaya mahal.

Yang kompleks, kami memasukkan data-data terus menganalisa, terus keluarlah simulasi. Itu kan, perlu computing proses yang tinggi. Bisa jutaan core untuk memproses angka-angka yang banyak, yang harusnya baru diselesaikan dalam berapa tahun, tapi ini dengan sistem yang besar dia bisa memproses. Dan kita kan harus masukin semua model-model di situ, input data, kita running.

Misal, kalau kita ingin menaikan pajak implikasinya itu apa sih? Terus penerimaan kita bertambah berapa sih? Jadi akhirnya pemerintah bisa mengambil kebijakannya cepat.

Jadi contohnya itu kan urusan Menterian Keuangan maksudnya hal-hal itu bisa digunakan tadi kan yang kompleks karena butuh sistem besar. Untuk mengandalkan sistemnya sendiri itu bisa miliaran dolar AS.

Tapi AI juga bisa punya masalah, yaitu dia bisa bias. Biasnya apa? Tergantung dari yang yang dibuat. Contohnya bisa bias itu kalau seleksi pegawai, penerimaan pegawai kalau dia tidak transparan dalam menyusunnya yang diterima orang-orang tertentu yang sesuai dengan desainernya. Nah itu bisa terjadi diskriminasi.

Makanya di undang-undang PDP itu ada hak warga sebagai subsidiari. Bisa ajukan keberatan jika dievaluasi pakai mesin dan meminta direview dengan manusia dan bisa membantah.

Contohnya dia mengambil data-data yang sudah invalid makanya jadi merugikan orang yang bersangkutan. Siapapun yang menggunakan AI dia harus transparan, bagaimana dia mengelola datanya, variabel yang digunakan. Apalagi sekarang yang merugikan itu kan, juga menggunakan data-data sosial media. Bagaimana kalau sosial medianya itu sudah 10 tahun yang lalu? Kan manusia berubah. Kan bisa bias, kan kita tahu data-data di digital itu tidak pernah tidak bisa dihapus karena ada jejaknya.

Kalau AI bisa masuk ke sana, dia bisa mengambil data-data yang sudah, menurut saya, tidak relevan untuk menilai seseorang itu yang harus diperhatikan siapapun yang menggunakan AI. Transparansinya, akuntabelnya, bisa dipertanggungjawabkan, tidak bias, kalau bisa itu dibuat oleh beberapa orang jadi bisa saling check and balance.

Contohnya di Google. Saya datang ke Google, dia punya engineering dari berbagai negara. Saya tanya, memang di Amerika tidak ada orang? Mereka jawab, bukan itu. Tujuan mereka adalah supaya tidak bias. Karena tiap-tiap orang walaupun dia belajar ilmu komputer ya sama, tapi kan tiap-tiap orang kan dibesarkan berbeda, nah inilah memperkaya.

Penulis: Restu Diantina Putri

Editor: Muhammad Taufiq

Masuk tirto.id

Masuk tirto.id