tirto.id - Pertengahan Februari lalu, Forensic Architecture, lembaga non-profit yang rajin membongkar pemerintah dan perusahaan yang melakukan tindak kekerasan, menggelar eksibisi Miami Dade College Museum of Art and Design, Amerika Serikat. Eyal Weizman, salah satu pendiri lembaga asal London itu, berencana untuk menghadiri eksibisi tersebut.

Beberapa hari menjelang keberangkatannya ke Paman Sam, Kedutaan Besar AS di Inggris mengirimkan email yang mengatakan Weizman tidak diizinkan masuk ke teritori AS. Dengan kata lain, visa kunjungannya dicabut. Ketika Weizman mendatangi kedutaan dan kembali mengajukan permohonan visa, petugas kedutaan mengatakan “algoritma” milik AS mengidentifikasi bahwa Weizman "berbahaya".

“Petugas bilang algoritma menyatakan bahwa saya telah terlibat dalam suatu hal (kejahatan), atau saya telah bertemu dengan orang-orang (yang dianggap penjahat oleh Amerika), atau saya telah berkunjung (ke negara-negara yang dinilai rawan oleh Amerika, seperti Suriah, Iran, Irak, Yaman, atau Somalia), atau ada sebuah pola yang mengatakan saya terlibat (dalam kejahatan),” tutur Weizman, sebagaimana diwartakan Archpaper.

Menurut penuturan Weizman, ia akan diberikan jalur khusus pengurusan visa untuk masuk ke AS asalkan ia mengatakan dengan siapa saja ia bertemu selama beberapa bulan belakangan. Namun, sebagai seseorang yang bekerja sebagai aktivis Hak Asasi Manusia, Weizman menolak. Dengan tegas Weizman mengatakan bahwa “kita, sebagai warga negara, telah dipantau secara elektronik. Dipantau atas jaringan sosial, orang-orang yang kita temui, tempat, sambungan telepon, hingga transaksi yang kita lakukan.”

“Sistem pemantau seperti yang telah saya alami, menimbulkan banyak masalah,” tegasnya.

Hampir semua aspek dalam kehidupan sosial manusia telah dijamah perangkat digital. Orang-orang dipantau aktivitasnya, entah oleh pihak swasta maupun pemerintah, khususnya melalui data digital yang dihasilkan. Pemantauan pihak swasta yang bahkan menjadi skandal besar tatkala Donald Trump bekerjasama dengan Cambridge Analytica, lembaga analisis asal Inggris, untuk melakukan pengelompokan pemilih AS dan menggunakan pengelompokan itu untuk mengerahkan strategi pemasaran spesifik (microtargeting) dalam pilpres AS 2016.

Film dokumenter The Great Hack (2019) menyebutkan dukungan Cambridge Analytica untuk memenangkan Trump termaktub dalam proyek bernama “Alamo” Tugasnya sederhana: beriklan senilai $1 juta setiap hari di Facebook tentang keunggulan Trump atau kelemahan lawannya, Hillary Clinton. Konten yang diiklankan sifatnya terpersonalisasi (personalized), sehingga penggunaan data milik pengguna Facebook mutlak dibutuhkan. Masalahnya, Cambridge Analytica memperoleh data pengguna Facebook secara tidak sah.

Data pengguna Facebook diambil melalui aplikasi bernama The One Click Personality Test. Alih-alih hanya menambang data para pengguna aplikasi itu, Cambridge Analytica bermain curang. Mereka mengambil data dari teman-teman si pengguna aplikasi, tanpa persetujuan pengguna. Akhirnya, Cambridge Analytica sukses memiliki 5.000 titik data pada setiap pemilih.

Titik data yang lengkap itu, mengutip keterangan Chief Executive Officer Cambridge Analytica Alexander Nix, sukses menciptakan “profil psikologis” pemilih AS.

Contoh lainnya, ialah rekaman seluruh jejak pengguna Google Maps oleh Google. Semua tujuan, rute, dan titik-titik yang dikunjungi terekam oleh Google Maps. Perekaman tujuan dan rute dilakukan tanpa ada tindakan aktif si pemilik jejak digital untuk memberikan otorisasi. Google Maps mampu merekam jejak terutama bagi segala smartphone yang memasang aplikasi tersebut dengan mengaktifkan fitur GPS. Sayangnya, laporan Quartz menyebutkan Google tetap mengumpulkan data lokasi meskipun fitur lokasi atau GPS dimatikan pemilik smartphone. Tong Sun, pimpinan pada Scalable Data Analytics Research Lab yang berada di bawah naungan Xerox, menyatakaan dalam kolomnya di Wired bahwa aplikasi seperti Google Maps sanggup menawarkan “personalisasi” melalui jejak digital yang dikumpulkan.

Pada kasus Weizman, tidak ada yang tahu pasti bagaimana algoritma AS bekerja dan mendeteksi bahwa ia berbahaya bagi Amerika. Namun, laporan Kashmir Hill yang terbit di The New York Times mencurigai AS telah menggunakan alat bernama Clearview AI.

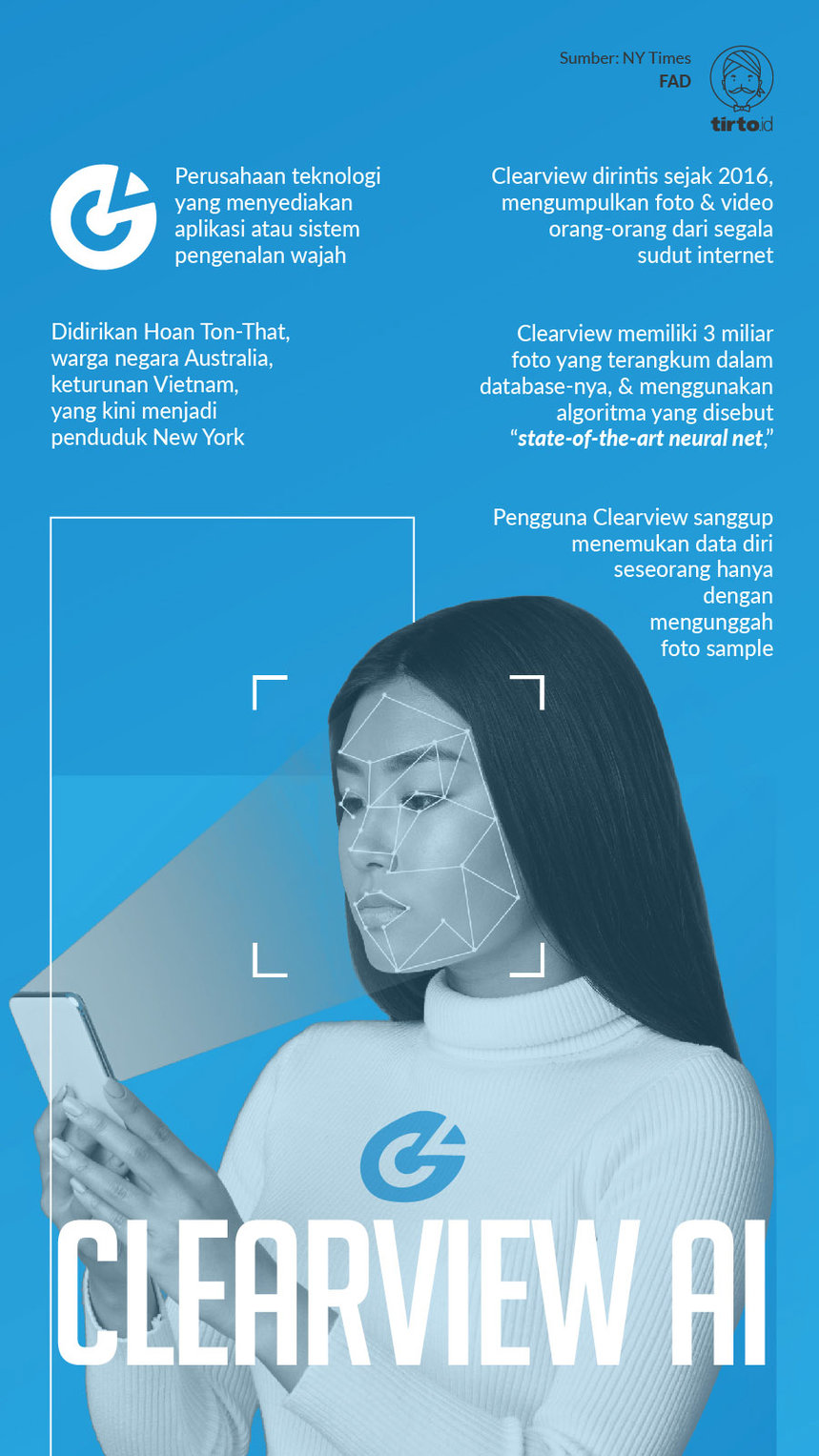

Dokumen yang diperoleh New York Times menyebutkan Clearview AI sebagai perangkat analisis yang diciptakan oleh perusahaan yang didirikan Hoan Ton-That, warga negara Australia keturunan Vietnam yang kini menjadi penduduk New York. Clearview AI disebut-sebut dapat menganalisis 3 miliar foto atau video dari orang-orang di seluruh dunia. Klaim Clearview, angka tersebut jauh lebih perkasa dibandingkan database yang dimiliki otoritas penegak hukum apapun di AS, termasuk FBI (yang disebut-sebut hanya memiliki 411 juta database foto), atau kepolisian Florida (47 juta foto), dan kepolisian Los Angeles (8 juta foto).

Kemampuan Clearview terlihat sangat istimewa. Sebelum Ton-That mendirikan Clearview, ia hanya seorang programmer biasa yang mencoba menciptakan produk digital seiring terjadinya boom aplikasi smartphone sejak kemunculan iPhone di 2007. Pada 2009, Ton-That menciptakan situs web yang memungkinkan pengguna membagi link video ke semua kontak di ponsel. Lalu, pada 2015, Ton-That membuat aplikasi foto, dan mengubah foto siapa pun sehingga punya rambut mirip Donald Trump.

Selepas gagal menjadi model di New York, Ton-That kemudian tenggelam dalam studi kecerdasan buatan, teknik pengenalan wajah, dan machine learning. Akhirnya, pada 2016, ia mendirikan Clearview, mengumpulkan foto dan video orang-orang dari segala sudut internet, mulai dari situs web kantor, sekolah, blog pribadi, hingga platform media sosial seperti Facebook, Youtube, Twitter, dan Instagram.

Dengan menambang data dari berbagai sumber internet, Clearview memiliki 3 miliar foto dalam database-nya. Lalu, Ton-That melengkapinya dengan “state-of-the-art neural net”, sebuah algoritma yang mampu mendeteksi siapa pun hanya dengan menggunakan sampel atau contoh foto dari sosok yang ditarget.

“Clearview membuat direktori besar dan mengelompokkan semua foto dengan vektor yang sama. Ketika seorang pengguna mengunggah foto ke dalam sistem Clearview, sistem mengubah wajah menjadi vektor dan kemudian menunjukkan semua foto yang memiliki kemiripan vektor, lengkap dengan link asal foto,” tulis Hill.

Sebanyak 600 lembaga penegak hukum tercatat menggunakan Clearview, termasuk FBI hingga Kementerian Keamanan Dalam Negeri AS (DHS). Beberapa perusahaan terkemuka dunia juga menggunakan Clearview.

Dalam wawancaranya dengan CNN, Ton-That menegaskan ia menciptakan Clearview untuk tujuan mulia, agar penegak hukum mudah menangkap penjahat. Klaimnya, di New Jersey, Clearview sukses digunakan untuk mengungkap pelaku predator anak-anak yang meresahkan warga. Lalu, dalam laman resmi Clearview, perusahaan menegaskan bahwa alat yang dibuat mereka ditujukan untuk “melakukan pencarian, bukan pengawasan.” Klaim lain: Clearview juga dibuat untuk “melindungi orang-orang yang tidak bersalah”.

Eric Goldman, peneliti pada University of Santa Clara, menyebut alat semacam Clearview sebagai “senjata tanpa batas”.

“Bayangkan seorang petugas penegak hukum jahat yang ingin membuntuti seseorang atau pemerintah asing menggunakan ini untuk menggali rahasia untuk memeras orang atau melemparkan mereka ke penjara,” tutur Goldman.

Ada kekhawatiran lain di luar potensi penyalahgunaan Clearview. AI masih belum sempurna dan sehingga dapat membahayakan orang-orang yang tidak bersalah. Klaim Ton-That sendiri, Clearview memiliki tingkat akurasi 99 persen mendeteksi orang, dan tingkat kesalahan mendeteksi orang-orang berkulit hitam atau Asia atau Hispanik cenderung kecil.

Namun, Rebecca Heilweil mematahkan klaim itu dalam paparannya di Recode.

Menurut Heilweil, machine learning, tipe kecerdasan buatan seperti Clearview AI, sangat bias dalam melakukan analisis. Untuk dapat menganalisis bahwa foto A milik Agus atau foto B milik Budi, misalnya, machine learning harus disuplai data yang berjumlah sangat banyak. Ketika, misalnya lagi, Clearview AI hanya mengunduh data lebih banyak dari orang-orang berkulit putih, Clearview akan kesulitan mendeteksi orang-orang berkulit hitam. Demikian sebaliknya. Lantas, bandingkan muka orang Amerika, Asia, Afrika, yang memiliki titik rentang berbeda, antara mata kanan dan kiri, dagu dan dahi.

Hal demikian membuat menciptakan sistem yang benar-benar dapat mendeteksi segala jenis wajah sukar dilakukan.

Studi bertajuk “Semantics Derived Automatically from Language Corpora Contain Human-like Biases” (2017) memaparkan, ketika kecerdasan buatan menggunakan data dari internet, seperti yang dilakukan Clearview, sistem yang dihasilkan akan menghasilkan prasangka buruk yang lebih pada orang-orang berkulit hitam dan perempuan.

“Banyak orang berpikir bahwa mesin tidak mungkin bias,” tutur Aylin Caliskan, ilmuwan komputer asal George Washington University. “Yang perlu diingat, mesin dilatih oleh data yang diberikan manusia. Dan manusia adalah makhluk yang bias.”

Pada 2018, Amazon bertindak diskriminatif pada perempuan melalui AI. Kala itu, untuk memudahkan proses perekrutan, Amazon menciptakan AI untuk melakukan proses screening pada CV dari orang-orang yang melamar pada Amazon. Amazon menggunakan kumpulan CV terdahulu dari orang-orang yang melamar. Masalahnya, kebanyakan CV berasal dari laki-laki. Akhirnya, mayoritas CV yang lolos adalah laki-laki, bukan perempuan.

Weizman nampaknya ketiban sial dengan algoritma AS yang membatalkan visanya, menghadiri acara Forensic Architecture di tanah yang dikuasai Trump. Jika praktik ini tak diawasi, "ketiban sial" yang dialami Weizman akan perlahan-lahan terlembaga.

Editor: Windu Jusuf